Yapay zeka verilerinizi bu şekilde çalıyor

Yapay zeka verilerinizi bu şekilde çalıyor

Yapay zeka verilerinizi bu şekilde çalıyor

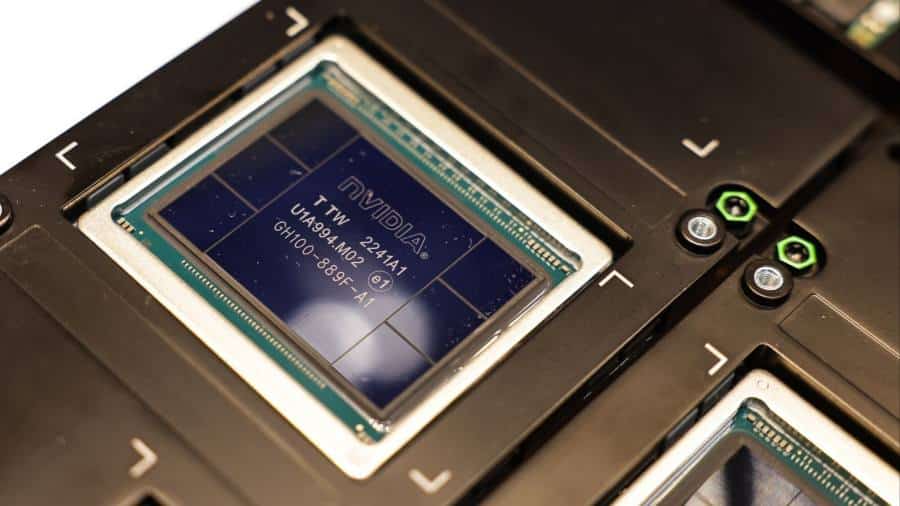

Amerikan ve İsviçre üniversitelerinden bir grup araştırmacı, Google ve yan kuruluşu DeepMind ile iş birliği içinde, çalışmalarını DALL-E, Imagen, veya Kararlı Difüzyon.

Hepsi, kullanıcının belirli bir metin istemine, örneğin "avokado şeklindeki koltuk" yazmasına ve saniyeler içinde metinden oluşturulmuş bir görüntü elde etmesine bağlı olarak aynı şekilde çalışır.

Bu platformlarda kullanılan üretken AI modelleri, önceden belirlenmiş bir açıklama ile çok sayıda görüntü üzerinde eğitilmiştir.Buradaki fikir, sinir ağlarının çok büyük miktarda eğitim verisini işledikten sonra yeni ve benzersiz görüntüler üretebilmesidir.

Ancak yeni çalışma, bu görüntülerin her zaman benzersiz olmadığını gösteriyor. Bazı durumlarda, sinir ağı, eğitimde kullanılan önceki bir görüntüyle tam olarak eşleşen bir görüntüyü yeniden üretebilir. Bu, sinir ağlarının yanlışlıkla özel bilgileri açığa çıkarabileceği anlamına gelir.

Bu çalışma, görüntüleri oluşturmak için kullanılan AI modellerinin eğitim verilerini kaydetmediği ve eğitim verilerinin ifşa edilmediği takdirde gizli kalabileceği görüşlerine meydan okuyor.

Daha fazla veri sağlayın

Derin öğrenme sistemlerinin sonuçları, uzman olmayanlar için şaşırtıcı olabilir ve bunların sihir olduğunu düşünebilirler, ancak gerçekte, bu konuda sihir yoktur, çünkü tüm sinir ağları çalışmalarını aynı prensibe, yani eğitime dayandırır. büyük bir veri seti ve her bir Resmin doğru tanımlarını kullanarak, örneğin: bir dizi kedi ve köpek resmi.

Eğitimden sonra, sinir ağı yeni bir görüntü gösterir ve bunun bir kedi mi yoksa bir köpek mi olduğuna karar vermesi istenir. Bu mütevazi noktadan, bu modellerin geliştiricileri daha karmaşık senaryolara geçerek, pek çok kedi görüntüsü üzerinde eğitilmiş bir algoritma kullanarak var olmayan bir evcil hayvanın görüntüsünü oluştururlar. Bu deneyler sadece görsellerle değil, metin, video ve hatta sesle de yapılıyor.

Tüm sinir ağları için başlangıç noktası eğitim veri setidir. Sinir ağları yoktan var ederek yeni nesneler yaratamaz. Örneğin, bir kedi görüntüsü oluşturmak için algoritmanın binlerce gerçek kedi fotoğrafını veya çizimini incelemesi gerekir.

Veri kümelerini gizli tutmak için büyük çaba

Makalelerinde, araştırmacılar makine öğrenimi modellerine özel bir önem veriyorlar ve şu şekilde çalışıyorlar: gürültü ekleyerek eğitim verilerini (insanların, arabaların, evlerin vb. görüntüleri) çarpıtıyorlar. Ardından, sinir ağı eski haline getirmek için eğitiliyor. bu görüntüleri orijinal hallerine getirin.

Bu yöntem, kabul edilebilir kalitede görüntüler üretmeyi mümkün kılar, ancak potansiyel bir dezavantajı - örneğin üretken rekabetçi ağlardaki algoritmalarla karşılaştırıldığında - veri sızdırma eğiliminin daha yüksek olmasıdır. Orijinal veriler ondan en az üç farklı şekilde çıkarılabilir, yani:

Sinir ağını, binlerce görüntüye dayalı olarak oluşturulmuş benzersiz bir şey değil, belirli bir kaynak görüntüyü çıkarmaya zorlamak için belirli sorgular kullanmak.

Orijinal görüntü, yalnızca bir kısmı mevcut olsa bile yeniden oluşturulabilir.

Belirli bir görüntünün eğitim verilerine dahil edilip edilmediğini basitçe belirlemek mümkündür.

Çoğu zaman, sinir ağları tembeldir ve yeni bir görüntü üretmek yerine, aynı görüntünün birden çok kopyasını içeriyorsa, eğitim setinden bir şey üretirler. Eğitim setinde bir görüntü yüz defadan fazla tekrarlanırsa, orijinaline yakın haliyle sızdırılma olasılığı çok yüksektir.

Ancak araştırmacılar, orijinal sette yalnızca bir kez görünen eğitim görüntülerini almanın yollarını gösterdi.Araştırmacıların test ettiği 500 görüntüden, algoritma rastgele üç tanesini yeniden oluşturdu.

Kimden çaldı?

Ocak 2023'te üç sanatçı, telif haklarına saygı duymadan çevrimiçi görüntülerini modellerini eğitmek için kullandıkları için yapay zeka tabanlı görüntü oluşturma platformlarına dava açtı.

Bir sinir ağı aslında bir sanatçının stilini kopyalayabilir ve böylece onu gelirinden mahrum edebilir. Makale, bazı durumlarda, algoritmaların, çeşitli nedenlerle, gerçek insanların çalışmalarıyla neredeyse aynı olan çizimler, fotoğraflar ve diğer görseller üreterek düpedüz intihal yapabildiğini belirtmektedir.

Bu nedenle araştırmacılar, orijinal eğitim grubunun özgüllüğünü artırmak için önerilerde bulundu:

1- Antrenman gruplarında tekrarı ortadan kaldırın.

2- Egzersiz görüntülerini, örneğin gürültü ekleyerek veya parlaklığı değiştirerek yeniden işleyin; Bu, veri sızıntısını daha az olası hale getirir.

3- Algoritmayı özel eğitim görüntüleri kullanarak test etmek, ardından istemeden doğru şekilde yeniden üretmediğini doğrulamak.

sırada ne var?

Üretken sanat platformları, son zamanlarda sanatçılar ve teknoloji geliştiricileri arasında bir dengenin aranması gereken ilginç bir tartışmayı ateşledi. Bir yandan telif haklarına saygı gösterilmelidir, öte yandan yapay zeka tarafından üretilen sanat insan sanatından çok mu farklı?

Ama güvenlik hakkında konuşalım. Makale, yalnızca bir makine öğrenimi modeli hakkında belirli bir dizi gerçek sunuyor. Konsepti tüm benzer algoritmalara genişleterek ilginç bir duruma geliyoruz. Bir mobil ağ operatörünün akıllı asistanının, bir kullanıcının sorgusuna yanıt olarak hassas şirket bilgilerini verdiği veya bir kamu sinir ağını birinin pasaportunun bir kopyasını oluşturması için yönlendiren hileli bir komut dosyası yazdığı bir senaryo hayal etmek zor değil. Ancak araştırmacılar, bu tür sorunların şimdilik teorik olarak kaldığını vurguluyor.

Ancak şu anda yaşadığımız başka gerçek sorunlar da var, çünkü aşağıdakiler gibi betik oluşturma modelleri: ChatGPT artık gerçek kötü amaçlı kod yazmak için kullanılıyor.

Ve GitHub Copilot, programcıların girdi olarak büyük miktarda açık kaynak yazılımı kullanarak kod yazmasına yardımcı olur. Ve araç, kodları çok geniş bir eğitim verisi setinde son bulan yazarların telif haklarına ve mahremiyetlerine her zaman saygı göstermez.

Sinir ağları geliştikçe, henüz kimsenin anlamadığı sonuçlarla onlara yönelik saldırılar da gelişecek.